L’intervento che viene proposto è una delle prime elaborazioni massoniche sulla nuova realtà dell’intelligenza artificiale. L’autore è un esperto informatico, che sta approfondendo l’uso e la riflessione etico-filosofica sull’IA. È una delle tante visioni possibili, non ci fermeremo a questa, ma proporremo altri punti di vista perché da una disamina complessa ciascuno possa trarre elementi per formare una personale opinione. La specificità di questa narrazione è che in realtà è stata elaborata in coppia, l’autore umano con l’autore artificiale.

Per affrontare il tema oggetto della tavola a mio modo di vedere occorrerebbe partire dal concetto di coscienza che da secoli è oggetto di analisi e studi da parte di filosofi, scienziati e pensatori. La coscienza può essere descritta come la consapevolezza di sé stessi e dell’ambiente circostante. Essa permette di sperimentare sensazioni, pensieri ed emozioni in maniera soggettiva.

Filosoficamente, le discussioni sulla coscienza toccano questioni di identità personale, libero arbitrio e la natura dell’esistenza stessa e sono state già affrontate, seppur toccando temi correlati ad essa, nella filosofia greca dove sono state esplorate le questioni dell’essere, della conoscenza e dell’esistenza soggettiva. Socrate (469 a.C: – 399 a.C.), attraverso i dialoghi platonici, con la frase “Conosci te stesso” esortava all’autoconsapevolezza e all’esplorazione interiore che, possono essere considerate riflessioni primordiali sul concetto di coscienza.

Platone (428 a.C: – 348 a.C.) avanzò una visione dualistica dell’uomo, distinguendo tra il corpo, che percepisce il mondo materiale attraverso i sensi, e l’anima, che accede al mondo delle idee o delle forme eterne.

In epoche più recenti René Descartes (1596 – 1650), con il suo famoso dictum “Cogito, ergo sum” (“Penso, quindi sono”), ha ulteriormente posto le basi del dualismo cartesiano, secondo cui mente e corpo sono sostanze separate. Per Descartes, la coscienza è la caratteristica distintiva della mente, dimostrando l’esistenza del sé come entità pensante e separata dal mondo materiale.

Immanuel Kant (1724 – 1804) ritiene che la mente struttura l’esperienza secondo concetti e categorie a priori. La coscienza, per Kant, non è solo passiva ricezione di impressioni, ma un’attività che dà forma e ordine alla realtà, rendendo possibile l’esperienza coerente del mondo.

Friedrich Nietzsche (1844 – 1900) aggiunge alla coscienza l’esperienza della lingua e delle convenzioni sociali. Per Nietzsche, la coscienza emerge come un meccanismo di adattamento che permette agli individui di negoziare le loro relazioni sociali, spesso a discapito delle forze istintive e irrazionali che sottendono l’esistenza umana.

Nell’era contemporanea, John Searle (1932) ha proposto il “materialismo biologico” nel tentativo di conciliare la natura fisica della coscienza con la sua qualità esperienziale sostenendo che, mentre la coscienza è un fenomeno strettamente legato ai processi fisici del cervello, possiede anche proprietà qualitative che sono soggettivamente esperite e non riducibili a processi fisici.

Daniel Dennett (1942) nel libro “Consciousness Explained” pubblicato nel 1991, sostiene una visione che nega l’esperienza soggettiva indicando che la coscienza può essere completamente spiegata in termini di processi computazionali e meccanismi neurali.

Dal punto di vista scientifico la coscienza presenta ancora molti misteri e numerose domande aperte. Il tentativo degli scienziati fino ad ora è stato quello di cercare di mappare e comprendere le attività neuronali nel cervello e come possono tradursi in esperienze coscienti. Alcuni teorizzano che la coscienza emerga dalla complessa interazione di varie parti del cervello, ma i dettagli di questo processo rimangono in gran parte sconosciuti.

La conoscenza acquisita sulle reti neurali del cervello sono ad oggi la base su cui si fondano i principi architetturali ed ingegneristici dell’Intelligenza Artificiale (AI). L’approccio si fonda sull’idea di imitare la struttura e il funzionamento delle reti neurali biologiche del cervello umano per sviluppare sistemi di AI capaci di apprendere, ragionare e prendere decisioni in maniera simile all’intelligenza umana. La tecnologia che ne deriva, nota come reti neurali artificiali (RNA), ha portato a progressi significativi in vari campi, dalla visione artificiale (Computer Vision) all’elaborazione del linguaggio naturale (NLP Natural Language Process).

Le reti neurali artificiali sono quindi ispirate alla struttura del cervello umano, che è composto da miliardi di neuroni interconnessi. Ogni neurone riceve segnali da altri neuroni; se il segnale elettrico totale ricevuto supera una certa soglia, il neurone si “attiva” e invia a sua volta un segnale ai neuroni successivi. Le RNA imitano questo comportamento utilizzando unità di elaborazione che simulano i neuroni. Queste unità sono connesse e ad ognuna è associato un “peso” specifico, che può essere aggiustato durante il processo di apprendimento, permettendo alla rete di “imparare” da esperienze passate.

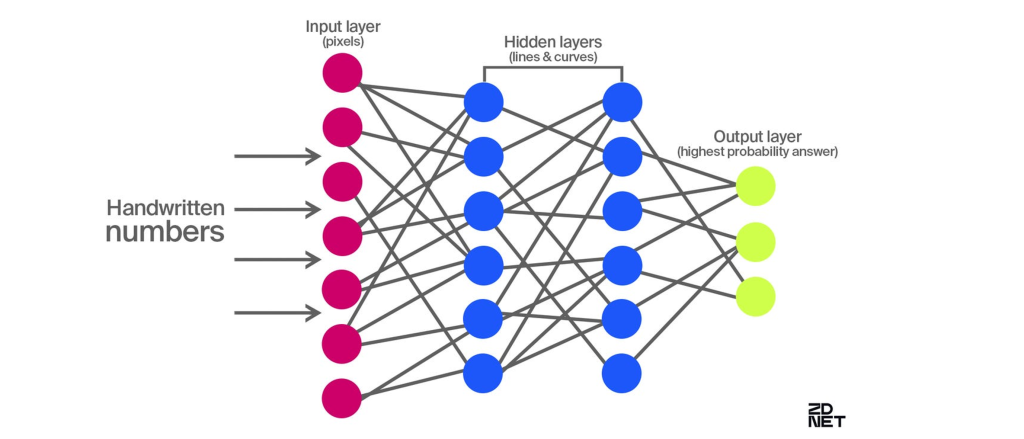

L’apprendimento profondo, o Deep Learning, è una tecnica specifica dell’AI che si basa sulla struttura e sulle funzionalità delle reti neurali artificiali (RNA). Una caratteristica distintiva del deep learning è l’organizzazione dei neuroni artificiali in strati multipli, che consente alla rete di apprendere rappresentazioni dei dati a diversi livelli di astrazione. Questi strati sono generalmente suddivisi in tre categorie principali: strati di input, strati nascosti e uno strato di output. Ogni strato serve a un diverso scopo nell’elaborazione dei dati e nell’apprendimento delle caratteristiche.

Strato di Input: Questo è il primo livello della rete neurale e ha il compito di ricevere i dati in ingresso. Ogni neurone in questo strato rappresenta una caratteristica specifica del dato di input.

Strati Nascosti: Tra lo strato di input e quello di output, ci sono uno o più strati nascosti. Questi strati sono il cuore dell’apprendimento profondo. Ciascuno strato nascosto trasforma l’input ricevuto dallo strato precedente attraverso una combinazione di pesi (che rappresentano la forza delle connessioni sinaptiche nel cervello) e funzioni di attivazione (che decidono se un neurone si “attiva” o meno, basandosi sui segnali ricevuti). Man mano che i dati passano attraverso gli strati nascosti, la rete neurale apprende rappresentazioni sempre più complesse e astratte. Gli strati più vicini all’input potrebbero imparare a riconoscere caratteristiche semplici, mentre gli strati più profondi potrebbero imparare a identificare caratteristiche o sfumature più complesse di un problema. Più strati nascosti ci sono e più la rete neurale è considerata complessa.

Strato di Output: L’ultimo strato della rete produce il risultato finale dell’elaborazione. Il numero di neuroni in questo strato e la funzione di attivazione utilizzata dipendono dal tipo di problema che la rete neurale sta cercando di risolvere. Per esempio, in un compito di classificazione, lo strato di output potrebbe avere un neurone per ogni classe possibile.

Facciamo un esempio semplice e comprensibile anche a chi non ha conoscenze di tecnologia informatica: Immaginiamo di avere un album di figurine con immagini di frutta (mele, banane, arance e così via). E supponiamo di voler insegnare a un bambino piccolo, che non ha mai visto la frutta prima, a riconoscere i diversi tipi solo guardando le figurine. Il cervello del bambino, con la sua rete biologica neurale, si comporterà come l’AI mentre cerchiamo di insegnargli a riconoscere le immagini.

Lo strato di Input sarà rappresentato dalla visione di alcuni aspetti delle figurine. Mostreremo al bambino una figurina alla volta. Invece di vedere la figurina come un’immagine complessiva, il bambino la analizza come una collezione di macro dettagli: un pezzettino è rosso, un altro è giallo, un altro ancora ha una forma curva, e così via. Ogni pezzettino di dettaglio è come un “neurone” nello strato di input della rete neurale.

Durante l’apprendimento, diciamo al bambino che la figurina con molti pezzetti rossi e una forma rotonda molto probabilmente è una mela. All’inizio, è un po’ confuso perché non sa cosa rende una mela diversa ad esempio da una banana. Ma continuando a mostrargli diverse figurine, spiegando ogni volta quale frutto è rappresentato, il bambino inizia a notare dei modelli: “Ah, se vedo qualcosa di lungo e giallo, di solito è una banana!”. Questo processo di iniziare a capire e riconoscere i modelli è simile a quello che accade negli “strati nascosti” di una rete neurale durante l’apprendimento profondo. Il bambino sta essenzialmente “addestrando” il suo cervello a riconoscere i frutti basandosi sui dettagli che sono stati mostrati all’interno della figurina.

Dopo un po’, il bambino sarà bravissimo a identificare la frutta. Quando vede una figurina dirà immediatamente se c’è una mela o una banana, anche se è una figurina che non ha mai visto prima! Questo è lo strato di output in una rete neurale: dopo l’addestramento, la rete è in grado di prendere nuove immagini (o figurine, nel nostro esempio) e identificare correttamente cosa mostrano.

Il successo del deep learning è in parte dovuto alla sua capacità di catturare automaticamente le caratteristiche importanti dei dati senza bisogno di una progettazione di caratteristiche manuale notoriamente sviluppata in passato via software con gli algoritmi, che è sia difficile sia limitante. Queste reti possono imparare rappresentazioni complesse dei dati, migliorando la loro performance in compiti come il riconoscimento vocale, la traduzione automatica e il gioco di strategia.

Oltre alla suddivisione in strati, un altro aspetto fondamentale del deep learning nel processo di apprendimento, e già accennato, riguarda la sua capacità di “aggiustare” i pesi delle connessioni tra i neuroni in itinere. Questo avviene tipicamente attraverso un processo noto come retropropagazione (backpropagation), in cui l’errore di output viene calcolato rispetto al risultato desiderato, e questo errore viene poi propagato all’indietro attraverso la rete per aggiustare i pesi futuri della rete in modo da ridurre l’errore nelle successive previsioni.

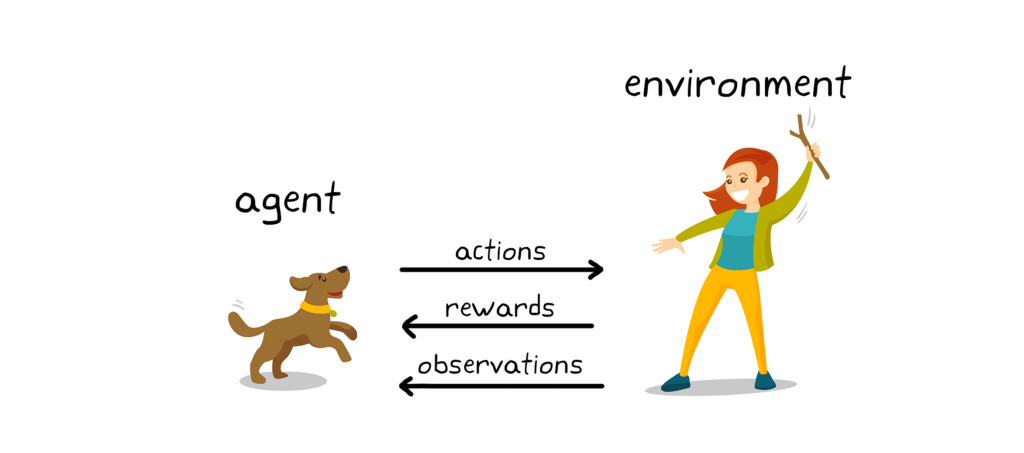

Altra metodologia di AI utilizzata è quella del Reinforcement Learning (apprendimento per rinforzo). Si tratta di un tipo di apprendimento in cui un “agente” impara a prendere decisioni ottimizzando le sue azioni in un ambiente specifico per massimizzare un segnale di ricompensa. L’agente esplora l’ambiente e riceve ricompense o punizioni in base alle azioni che intraprende, imparando così quale sequenza di azioni porta ai migliori risultati complessivi.

La caratteristica chiave del Reinforcement Learning (RL) è quindi nella capacità di imparare da un feedback ritardato. È una tecnica che si adatta bene ad affrontare problemi dove le informazioni sono incomplete o provengono da ambienti complessi e in continuo cambiamento. È stato utilizzato con successo per sviluppare sistemi in grado di superare gli umani in giochi complessi, come gli scacchi, e per applicazioni come la navigazione di robot e la gestione ottimale di sistemi energetici.

Un esempio classico con cui spiegare il RL è quello dell’insegnamento di alcuni comportamenti a un cane come sedersi o portare indietro una palla. In questo scenario, il cane è l’agente nell’ambiente di apprendimento per rinforzo, e l’obiettivo è far sì che impari a eseguire determinati compiti attraverso un sistema di ricompense e penalità.

Lo scenario è l’ambiente o lo spazio in cui il cane opera. Include tutto ciò con cui il cane può interagire, come la palla, il terreno su cui si trova, e il padrone che dà i comandi.

L’agente è il cane che deve imparare da solo come eseguire i compiti attraverso la sperimentazione e l’interazione con l’ambiente.

Le azioni sono le cose che il cane può fare. Ad esempio, camminare in avanti, girarsi, abbaiare, sedersi, saltare, o correre verso la palla. All’inizio, il cane “prova” queste azioni a caso perché non sa ancora quale sia la risposta corretta a un comando.

Gli stati rappresentano la situazione attuale dell’ambiente dal punto di vista del cane. Ciò include la sua posizione, la posizione della palla, e se ha sentito un comando dal padrone.

Il sistema di ricompense e penalità è fondamentale nel RL. Ogni volta che il cane esegue un’azione, riceve una risposta sotto forma di ricompensa o penalità. Se il cane esegue l’azione desiderata, come sedersi quando gli viene detto di “Siediti”, riceve una ricompensa (positiva). Se fa qualcosa di indesiderato, potrebbe ricevere una penalità (negativa) o nessuna ricompensa.

Attraverso il processo di prova ed errore e il feedback costante dell’ambiente, il cane inizia a capire quali azioni portano a ricompense maggiori. Ad esempio, scopre che ogni volta che si siede dopo aver sentito il comando “Siediti”, ottiene una ricompensa (come una carezza o un bocconcino). Quindi, impara che “Siediti” in risposta al comando corrispondente è un’azione che vale la pena ripetere.

L’obiettivo finale è che il cane apprenda autonomamente il comportamento corretto per ogni comando, ottimizzando le sue azioni per massimizzare le ricompense totali. Con il tempo, diventa più abile nel capire cosa ci si aspetta da lui in diversi scenari, migliorando la sua “intelligenza” e la capacità di eseguire i compiti.

Una delle sfide principali nello sviluppo delle RNA è quella di riuscire a replicare la straordinaria efficienza energetica e la capacità di apprendimento del cervello umano. Nonostante gli enormi progressi nel campo, le reti neurali artificiali sono ancora lontane dal raggiungere l’efficienza del cervello umano in termini di consumo energetico e capacità di elaborazione. Inoltre, mentre le RNA possono eccellere in compiti specifici (definita anche AI debole), mancano della flessibilità e della capacità di apprendimento generale del cervello umano.

L’intelligenza artificiale forte, spesso chiamata anche AI generale (AGI, Artificial General Intelligence), si riferisce a un tipo di intelligenza artificiale che possiede la capacità di comprendere, apprendere e applicare conoscenze in maniera molto simile, se non identica, a quella umana. A differenza delle intelligenze artificiali “deboli”, l’intelligenza artificiale forte sarebbe teoricamente in grado di eseguire qualsiasi compito intellettuale che un essere umano può fare.

Alcune caratteristiche dell’Intelligenza Artificiale Forte sarebbero:

- La capacità di apprendere da una vasta gamma di esperienze e contesti, non limitati a un singolo compito o a una singola disciplina;

- La capacità di risolvere problemi complessi, prendere decisioni in situazioni nuove e applicare il ragionamento logico;

- La capacità di comprendere e produrre il linguaggio umano in tutti i suoi aspetti, inclusi i sottintesi;

- Teoricamente, potrebbe includere una forma di auto-consapevolezza o persino emozioni (la coscienza…), sebbene questo sia un argomento di grande dibattito e speculazione.

Al momento, l’Intelligenza Artificiale Generale rimane un obiettivo a lungo termine piuttosto che una realtà imminente. Gli sviluppi nell’AI fino ad oggi sono stati prevalentemente nel campo delle AI deboli o specializzate, che sono incredibilmente avanzate nei loro domini specifici ma non possiedono la flessibilità o la generalità dell’intelligenza umana.

Il passaggio da un’intelligenza artificiale specializzata a una generale richiederà probabilmente sia progressi tecnologici significativi che nuove intuizioni nel modo in cui comprendiamo l’intelligenza stessa. Nonostante queste sfide, la ricerca nell’AGI continua, alimentata dalla speranza di ciò che potrebbe un giorno essere possibile.

L’idea di creare una forma di intelligenza che possa eguagliare o superare l’intelligenza umana in tutti i campi è sia affascinante che spaventosa. Il suo sviluppo potrebbe portare a progressi straordinari in medicina, scienza, ingegneria, e praticamente ogni altro campo, dato che un’AI con tali capacità potrebbe teoricamente accelerare la scoperta e l’innovazione a un ritmo inimmaginabile.

Tuttavia, l’idea solleva anche questioni etiche e di sicurezza significative. Se una macchina avesse una intelligenza e una capacità decisionale paragonabile a quella umana, quali diritti dovrebbe avere? E come possiamo garantire che le sue azioni siano allineate con gli interessi umani? E per la proprietà transitoria pone quesiti anche su coscienze non umane come quelle degli animali.

Dopo una inevitabile esplicitazione di cos’è l’AI arriviamo adesso al tema centrale: Qual è il ruolo del massone in un futuro di questo genere?

Una analisi in tal senso porta inevitabilmente a riflessioni profonde sulle questioni etiche, sociali e filosofiche che tale futuro potrebbe presentare. La massoneria, con le sue radici storiche nell’illuminismo e nel promuovere valori di libertà, uguaglianza, e fraternità, potrebbe avere un compito importante in un contesto simile.

Un ruolo importante potrebbe giocarlo nel promuovere un quadro etico per lo sviluppo e l’implementazione dell’AI. Data la sua lunga storia di impegno in tal senso, sui diritti umani e del progresso sociale, la massoneria potrebbe fungere da ponte tra la comunità tecnologica, il pubblico e i responsabili politici, enfatizzando l’importanza di un’AI che sia sviluppata e utilizzata in modi che rispettino la dignità umana e promuovano il benessere collettivo.

Potrebbe anche impegnarsi nell’educare i suoi membri e il pubblico sull’AI, sui suoi potenziali benefici e sui rischi etici, sociali ed economici associati. Attraverso programmi educativi, conferenze e dibattiti, potrebbe contribuire a creare una maggiore consapevolezza delle questioni complesse che circondano l’IA, promuovendo una comprensione più profonda delle sue implicazioni per la società.

Potrebbe assumere un ruolo di “advocacy” per i principi di responsabilità e trasparenza nello sviluppo dell’AI. La massoneria dovrebbe utilizzare la sua influenza per sostenere normative e politiche che garantiscano che lo sviluppo dell’AI sia condotto con un’adeguata supervisione, che le decisioni algoritmiche siano trasparenti e che ci siano meccanismi per prevenire e mitigare gli impatti negativi sulla società.

Potrebbe offrire uno spazio di riflessione filosofica e morale sui cambiamenti che l’IA apporterà alla condizione umana. Le questioni che riguardano l’autonomia, la libertà, l’identità nel contesto dell’AI possono beneficiare di una discussione approfondita all’interno di una comunità che valuta la riflessione morale e il miglioramento personale.

Ma tornando al tema con cui ho aperto la mia tavola, e che ritengo sia elemento centrale del lavoro di ogni massone quando lavora la “pietra grezza” che è dentro di sé, la massoneria potrebbe affiancare alla riflessione classica della coscienza e del suo significato ad un nuovo concetto: la macchina può avere una coscienza? Ciò implica dover esaminare non solo gli aspetti tecnologici e scientifici della questione ma anche quelli filosofici ed etici, ponendo domande fondamentali sulla natura dell’esistenza, dell’identità e dell’autocoscienza.

In termini di diritti e doveri, potrebbe promuovere un dialogo aperto su come una società dovrebbe trattare le entità intelligenti non umane. Questo dialogo potrebbe esplorare se le AI coscienti dovrebbero avere diritti simili a quelli degli umani e quali doveri avrebbero nei confronti della società. Si tratterebbe di bilanciare la protezione delle AI, supponendo che possano avere esperienze soggettive, con la necessità di salvaguardare il benessere umano e sociale. Immaginiamo per un attimo un futuro in cui l’unione dell’AI alla sperimentazione della robotica generi la nascita di esseri (creati dall’uomo) con una propria coscienza e simili a noi.

Esiste poi una questione alquanto delicata da dover affrontare: se un’AI cosciente è da considerarsi pari o inferiore a un essere umano. La massoneria potrebbe adottare un approccio basato sui principi di uguaglianza, libertà e fraternità, sostenendo che ogni entità cosciente merita rispetto e considerazione etica. Tuttavia, definire cosa costituisca “parità” in questo contesto richiederebbe un’attenta considerazione delle capacità uniche, delle esperienze e del potenziale impatto sociale di tali entità.

Sembrano ragionamenti lontanissimi, quasi a perdersi nel tempo futuro, eppure non è così.

Si pensi ad esempio all’applicazione dell’etica all’intelligenza artificiale nel contesto della guida autonoma di un’autovettura. Uno degli esempi più discussi è il così detto “dilemma del tram”, una situazione ipotetica utilizzata per esplorare decisioni morali riguardanti conflitti etici. Quando applicato alle auto a guida autonoma, questo dilemma si manifesta nelle decisioni che il sistema di intelligenza artificiale deve prendere in frazioni di secondo in scenari di potenziale collisione.

Immaginiamo un’auto a guida autonoma che viaggia su una strada cittadina. All’improvviso, un gruppo di pedoni attraversa la strada illegalmente e l’auto si trova di fronte a una scelta critica: continuare dritto, rischiando di colpire i pedoni, o sterzare per evitarli, mettendo in pericolo i passeggeri dell’auto o magari i pedoni che nella corsia opposta stanno attraversando regolarmente la strada. Quale scelta dovrebbe compiere l’AI?

Possono essere applicati diversi principi:

- Quello dell’Utilitarismo che suggerisce di scegliere l’azione che massimizza il benessere complessivo o minimizza il danno. Applicato all’auto a guida autonoma, potrebbe significare scegliere l’azione che salva il maggior numero di vite, anche se ciò comporta sacrificare il passeggero;

- Quello della Deontologia che pone l’accento sul seguire regole morali assolute. Secondo questo principio, l’auto potrebbe avere come regola non deviare mai dal suo percorso per colpire qualcuno intenzionalmente, indipendentemente dal risultato;

- L’Etica della Virtù che si concentra sul carattere e sulle virtù dell’agente morale piuttosto che sulle singole azioni. In questo contesto, la decisione dell’auto potrebbe basarsi su quale azione è più in linea con le virtù di un “buon” agente intelligente, come la prudenza o la compassione.

Studi americani hanno cercato di generare una sorta di etica collettiva chiedendo agli esseri umani (intervistati attraverso questionari web) come, a loro avviso, l’AI dovrebbe comportarsi in determinate situazioni limite. L’analisi ha evidenziato regole etiche differenti a fronte di astrazioni culturali, religiose e geografiche differenti. Gli orientali sacrificherebbero i giovani piuttosto che gli anziani, gli statunitensi sacrificherebbero un uomo di colore piuttosto che un bianco e gli europei investirebbero persone grasse piuttosto che sportive.

Con l’Intelligenza Artificiale l’uomo forse prova a soddisfare il suo sogno millenario di imitare Dio divenendo lui stesso il creatore, ma il rischio di portarsi dietro retaggi etici, sociali e culturali atavici è piuttosto alta, e quest’ultimo esempio lo dimostra.

È proprio qui che si innesca un imponente lavoro che la Massoneria del XXI secolo ha il dovere di compiere per il bene dell’umanità intera.

La Massoneria deve farsi garante che il processo di sviluppo dell’AI non innesti dentro di sé retaggi culturali primordiali che periodicamente e ricorsivamente generano catastrofi nella storia dell’umanità. Abbiamo l’opportunità da un lato di “azzerare” attraverso queste nuove tecnologie tali errori del passato favorendo il superamento delle disuguaglianze, delle sopraffazioni e favorendo il “bene comune”, dall’altro, in caso di errore, moltiplicare esponenzialmente i rischi per l’umanità dovuti ad autonomia intellettiva sotto il controllo di pochi.

Queste prime riflessioni sul rapporto tra massoneria sono un esempio di quanto può fare l’IA, comunque guidata, indirizzata e verificata da mente umana.